2019年7月20、21日の2日間、「日韓コンピュータ音楽祭2019」が東京都内で開かれた。韓国から気鋭の作曲家や研究者が6人招かれ、メディアシステムを駆使した音楽が披露された。

ところが、この音楽祭が開かれた時期に、日韓関係が戦後最悪などと報じられていた。

いわゆる「徴用工問題」を契機に、日韓関係は冷え込んでいた。公益財団法人韓昌祐・哲(ハンチャンウ・テツ)文化財団からの助成を得て、前出の音楽祭で企画構成を担当したACMP(アジア・コンピュータ・ミュージック・プロジェクト)代表の小坂直敏(オサカ・ ナオトシ)(東京電機大学未来科学部教授)は、次のように話す。

「こういう時期だからこそ、音楽祭を開く価値がありました。たとえ国家間で揉(も)めていても、文化というのは、国民同士が仲良くできる数少ないチャネルの一つでもあります。音楽祭はそこに貢献できると考えていました」

-

東京・赤坂にあるドイツ文化会館OAGホールで。韓国人作曲家のSeong-Joon Moon氏(左)と作品を演奏したピアニスト小坂絋未(オサカ・ヒロミ)氏(右)と最終演目の演奏打ち合わせをする小坂直敏氏。

東京・赤坂にあるドイツ文化会館OAGホールで。韓国人作曲家のSeong-Joon Moon氏(左)と作品を演奏したピアニスト小坂絋未(オサカ・ヒロミ)氏(右)と最終演目の演奏打ち合わせをする小坂直敏氏。 -

この日は、午前8時からピアノの調律で始まり、午前中はAVシステムのセッティング。午後から各演奏家のリハーサルが16時まで続いた。ACMP代表として、入念なチェックをする。

この日は、午前8時からピアノの調律で始まり、午前中はAVシステムのセッティング。午後から各演奏家のリハーサルが16時まで続いた。ACMP代表として、入念なチェックをする。 -

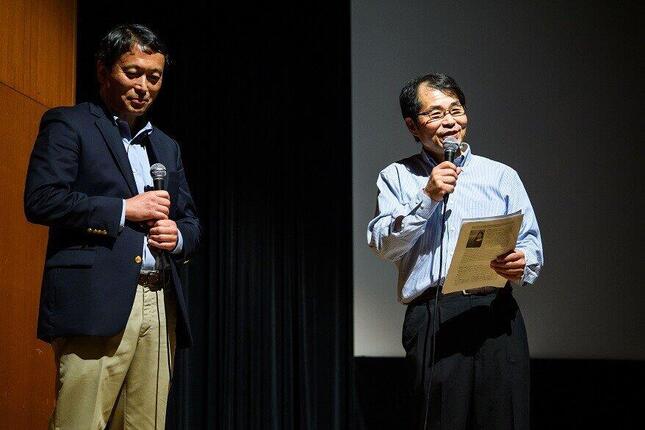

今回、参加した作曲家で音楽理論家として知られる桜美林大学芸術文化学群音楽専修の高岡明教授を舞台で紹介する。

今回、参加した作曲家で音楽理論家として知られる桜美林大学芸術文化学群音楽専修の高岡明教授を舞台で紹介する。 -

「日韓コンピュータ音楽祭2019」終了後、2日間のプログラムに登場した作曲家と演奏家たち。後列左から、岩田渉氏、Seong-Joon Moon氏、Seongah Shin氏、佐藤洋嗣氏、多井智紀氏、森威功氏、由雄正恒氏、Jongwoo Yim氏、前列左から、Heejo Choi氏、小坂絋未氏、小坂直敏氏、Jenny-Jiyoun Choi氏。

「日韓コンピュータ音楽祭2019」終了後、2日間のプログラムに登場した作曲家と演奏家たち。後列左から、岩田渉氏、Seong-Joon Moon氏、Seongah Shin氏、佐藤洋嗣氏、多井智紀氏、森威功氏、由雄正恒氏、Jongwoo Yim氏、前列左から、Heejo Choi氏、小坂絋未氏、小坂直敏氏、Jenny-Jiyoun Choi氏。 -

小坂直敏(オサカ・ナオトシ) 1953年生まれ、早稲田大学大学院修士課程修了。78年、日本電信電話公社電気通信研究所入社。85年、NTT基礎研究所主任研究員。コンピュータ音楽の研究に従事。2003年、東京電機大学工学部情報メディア学科教授。2010年、ACMPを設立した。

小坂直敏(オサカ・ナオトシ) 1953年生まれ、早稲田大学大学院修士課程修了。78年、日本電信電話公社電気通信研究所入社。85年、NTT基礎研究所主任研究員。コンピュータ音楽の研究に従事。2003年、東京電機大学工学部情報メディア学科教授。2010年、ACMPを設立した。

脳波を映像処理して作った曲

そもそも、<コンピュータ音楽>と聞いて、どんな音楽を思い浮かべるだろうか。

例えば女性3人のテクノポップユニット、Perfumeの音楽は、ナマの声をコンピュータ処理で変えたり、背後の空間や物体に映像を投影して独特の世界を演出したりするプロジェクションマッピングなどのテクノロジーが使われている。「そういう意味では、彼女たちの音楽の一部にコンピュータ音楽が使われているといえる」(小坂)。コンピュータ音楽は、音に加え、映像も含めて表現されることが多くなっているからだ。

また昨年、美空ひばりを最新のAI(人工知能)技術によって現代に「甦らせる」試みが話題になった。AIが作曲するコンピュータ音楽は出てきているが、「AI美空ひばり」が、このカテゴリーの中に入るかは、定義する人によって違ってくるだろうと小坂は言う。

では、<コンピュータ音楽>の定義とはどんなものだろう。

小坂によれば、「音楽の本質的な部分にコンピュータが関わっているか」がポイントだという。例えば、パイプオルガンに空気を送り込む際、正確な量を供給するためにコンピュータを使う場合は、コンピュータ音楽には該当しない。音楽に間接的にコンピュータが関わっているだけだからだ。

それに対し、コップの中にビー玉を入れて振ったときに発する音をセンサーで検知し、コンピュータソフトを使って音楽に変換した場合は、コンピュータ音楽に該当する。また、人が話す声をコンピュータで加工し、楽器音に変換したり、あるいは、子どもの声を徐々に、何回も変化させ、滑(なめ)らかにバイオリンの音に変換する「モーフィング」という技術を使ったりするのもコンピュータ音楽にあたる。

「日韓コンピュータ音楽祭2019」では、演奏者の脳波を映像処理して、音響映像作品化した曲など、さまざま技術を使った作品が披露された。最近では、ポップミュージックやアート作品、展示にもコンピュータ音楽が活用されるケースも増えてきた。

ただ、このような状況になったのは最近のことで、長い間、コンピュータ音楽に対するイメージはどこか取っ付きにくいものだった。多くの人が聞いて楽しむ音楽というより、現代音楽に取り組む人々によって演奏され、ごく限られた層が楽しむ形で発展してきた。

「現代音楽を演奏する人は、常に新しい表現手段を探していて、そのアンテナにコンピュータ音楽が引っ掛かりやすかったのだと思います」(小坂)

当初、コンピュータ音楽の演奏家は、クラシックをはじめとした専門的教育を受けている層が中心になっていた。間口が狭いジャンルだったのだ。しかし時の流れとともに、たとえ楽譜は読めなくても、システムについて知識が豊富な人、サウンドを変化させて用いる映像や美術分野の人など、制作、演奏の双方に、さまざまなバックグラウンドを持った人が参入しやすい音楽になっていったのである。