触覚を「共有」し、アンドロイドアバターに「憑依」する――。VR(仮想現実)を介したコミュニケーションは、「声」だけに留まらなくなってきたようだ。

産業技術総合研究所(以下、産総研)と、電気通信大学および東京電機大学が、最新技術を用いた取り組みを、2024年3月にそれぞれ発表した。

幅広い周波数帯域の触覚信号を体験できる

現実世界では、目の前に誰もいない。しかしVRゴーグルをかぶると見える空間には相手がおり、しかも握手すると感覚が伝わる。

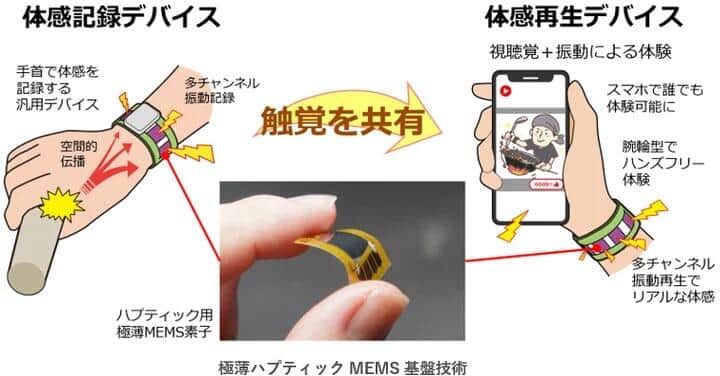

見る・聞くだけではなく、より没入感を味わえる「リアルな触感体験」を味わえるのが、産総研の開発した「双方向リモート触覚伝達システム」だ。3月8日付の発表資料によると、産総研の「極薄MEMS(微小電気機械システム)素子」による、ハプティックデバイスを活用。ハプティックとは「触覚」の意味で、「触覚による情報伝達を可能にする技術」を指す。

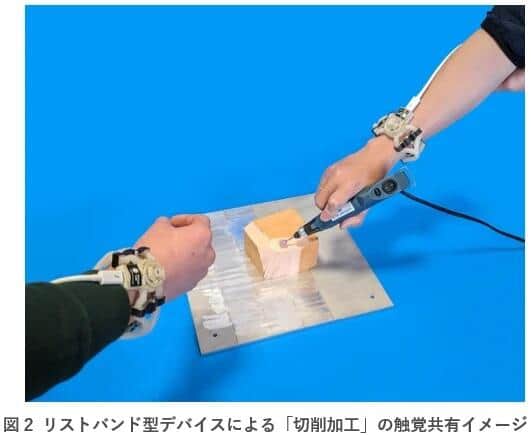

仕組みはこうだ。触覚デバイスと触覚信号編集技術を組み合わせ、幅広い周波数帯域の触覚信号を体験できるようにした。指先で触れる操作や、握手などの触覚情報を手首で計測し、それを相手側に伝えられるのが特長。「リストバンド型」や「ネイル型」、「指輪型」、「ペン型」といったように、ニーズや用途に合わせたデバイスを作成できる。

VRやAR(拡張現実)をはじめとしたエンターテインメント領域での「リアルな振動配信」や、遠隔地での振動体験の共有も使用例として想定している。例えば「工場作業などの技能伝達」も可能だ。

喜怒哀楽の表情を浮かべる「Yui」

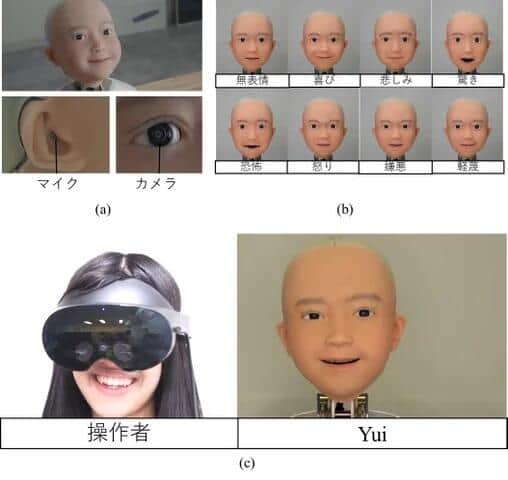

電気通信大学と東京電機大学は、アンドロイドアバター「Yui」の頭部ユニットと操作インタフェースを開発した。3月11日に発表。操作者の表情を、そのまま「アンドロイドの表情」として再現可能となる。従来のビデオ会議や音声通話と比べて、対面に近いコミュニケーションや、診察や面談への応用が期待できるという。

「Yui」は首の運動を含めて頭部の28か所が変形・動作でき、まるで人のように喜怒哀楽の表情を浮かべられる。両目、両耳に内蔵されたステレオカメラとステレオマイクで、Yuiがいる場所で見える映像、聞こえる音声も取得でき、操作者はそれを「VRヘッドセット」を着けて見聞きする。実際には見えていなくても、どこから、誰に呼びかけられたかがわかる。

VRヘッドセットには、操作者の頭部の回転や、目、眉など各パーツの変化を取得できるセンサーと、マイクを搭載。マイクで取得された音声は、Yuiの胸部に埋め込まれたスピーカーから再生される。