女性の写真を裸のものに変えられる、とするアプリ「DeepNude」が出現し、海外メディアを中心に物議をかもす騒動があった。

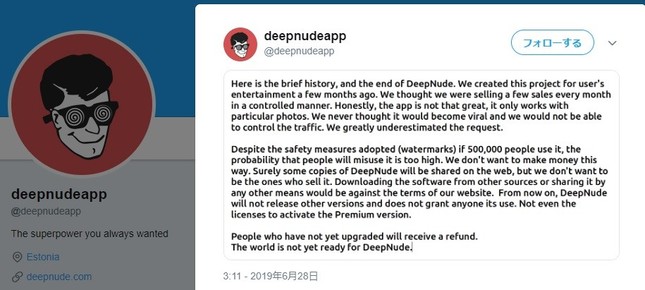

批判を浴びたアプリは削除された。作者側のツイッターアカウントが2019年6月28日3時10分ごろ(日本時間)、ツイートを更新し、「DeepNudeの終了」を宣言した。

「悪用する可能性は極めて高い」

アプリの問題点を伝えた、オンラインメディア「Motherboard」によると、アプリは偽動画などを生み出す「ディープフェイク」の技術を使っていた。同メディアはアプリについて、ディープフェイクよりも使いやすく、作るのも早いと指摘。リベンジポルノに対する改革団体関係者によるコメントとして、「絶対に恐ろしいこと。裸の写真を撮ったことがなくても、リベンジポルノの犠牲者になる可能性がある。この技術は公に利用されるべきではない」などと紹介し、警鐘を鳴らしていた。

AI技術を用いて作り出される合成動画、いわゆるディープフェイクは近年、米国などで相次いで現れている。17年には、ハリウッドの有名女優らが出演していると見せかけたポルノ動画が、ネット上に出回ったことが注目された。メディアサイト「CNET Japan」の報道によると、リベンジポルノを禁止する米国バージニア州ではディープフェイクの動画や画像も対象に加えられた。

今回問題となったDeepNudeは、ツイッターのプロフィール欄などでエストニアに本拠地を置くと称している。

プロジェクト終了に当たって、アカウントが投稿した文章の中で、「案全対策(ウォーターマーク)を採用したにもかかわらず、もし50万人が使用したら、人々が悪用する可能性は極めて高い」と説明。作った目的について、「このプロジェクトをユーザーの娯楽のために作った」と釈明。「今後、DeepNudeはほかのバージョンを公開しないし、誰にもその使用を許可しない」とつづった。最後の方で、

「世界はまだ、DeepNudeへの準備ができていない」

と見解を示した。

ディープフェイクの動きは政治分野にも及んでおり、昨18年には、偽のオバマ前米国大統領が話している偽動画に注目が集まった。またロイターの報道によると、19年5月にも米国では民主党のペロシ下院議長が講演中に、ろれつが回らず言葉につまっているように加工した偽動画がネットに上がり、フェイスブックYouTubeなどで拡散された。YouTubeは動画の削除対応をしたが、フェイスブックは削除せず、問題視された。

(J-CASTニュース編集部 田中美知生)